Custom GPTs und die Anarchie in der IT: Wie die Innovationskultur und Governance Hand in Hand gehen

Custom GPTs, die speziell auf die Bedürfnisse von Unternehmen zugeschnitten sind, machen den Einsatz von generativer KI (GenAI) erst wirklich produktiv. Da sie relativ schnell umzusetzen sind, dürften sich individuell angepasste KI-Agenten in Unternehmen schnell ausbreiten. Das bietet viele Chancen, kann aber auch zu Anarchie in der IT führen. Wir erklären, wie Unternehmen eine gute Balance zwischen Flexibilität und klaren Regeln finden können.

KI-Agenten sind das strategische Top-Thema der kommenden Jahre: Bis zum Jahr 2028 werden mindestens 15 Prozent der täglichen Arbeitsentscheidungen autonom von agentenbasierter KI (auch KI-Agenten genannt) getroffen, prognostizierte kürzlich das Marktforschungsinstitut Gartner. Eine etwas schlankere Alternative dazu sind sogenannte Custom GPTs. Doch was ist das genau?

Ein Generative Pre-trained Transformer (GPT) ist ein auf Künstlicher Intelligenz basierendes Sprachmodell, das darauf trainiert wird, Texte und Bilder zu generieren. Zu den bekanntesten zählen ChatGPT oder Microsoft Copilot. Eine Version davon sind Custom GPTs: Sie unterscheiden sich von den – eben genannten – universellen GPTs dadurch, dass sie an die spezifischen Anforderungen und Prozesse eines Unternehmens angepasst werden. Wie Organisationen von ihnen profitieren können, haben wir in diesem Artikel skizziert. Es ist davon auszugehen, dass diese maßgeschneiderten GenAI-Lösungen in Unternehmen stark zunehmen werden.

Begleitete Einführung erhöht Sicherheit und Akzeptanz

Jede Einführung solcher individualisierten KI-Anwendungen sollte jedoch eng von der IT-Abteilung des Unternehmens begleitet werden – aus mehreren Gründen.

Erstens brauchen Custom GPTs spezialisierte Trainings- und Feindatensätze. Wenn jede Abteilung oder Anwendung ihre eigenen Datenbestände verwendet, kann das zu einer Fragmentierung der Datenlandschaft im Betrieb führen. Die Folge: inkonsistente Datenqualität, Datenredundanz und eine schwierige Integration zwischen verschiedenen GPTs. Zweitens interagieren individuell angepasste GenAI-Anwendungen oft mit sensiblen Daten, die von Drittanbietern oder externen Systemen stammen. Eine nicht fachgerechte Konfiguration könnte vertrauliche Informationen gefährden.

Drittens können maßgeschneiderte KI-Anwendungen Informationen generieren oder Entscheidungen treffen, die nicht im Einklang mit regulatorischen Anforderungen stehen. Mangelnde Kontrolle erhöht das Risiko von Verstößen.

Wenn viele Abteilungen ohne zentrale Steuerung ihre eigenen GenAI Tools entwickeln, führt dies – viertens – unweigerlich zu einer Fragmentierung der IT-Landschaft im Unternehmen. Es drohen chaotische IT-Strukturen, Redundanzen in der Entwicklung und eine ineffiziente Nutzung von Ressourcen.

Und fünftens: Custom GPTs basieren oft auf Modellen oder Technologien, die sich schnell weiterentwickeln. Eine zentrale Betreuung der Anwendung stellt ihre Wartung und Pflege sicher. Veraltete KI-Apps hingegen brechen das Vertrauen und die Akzeptanz der Mitarbeitenden.

Der Dreiklang gegen die Anarchie

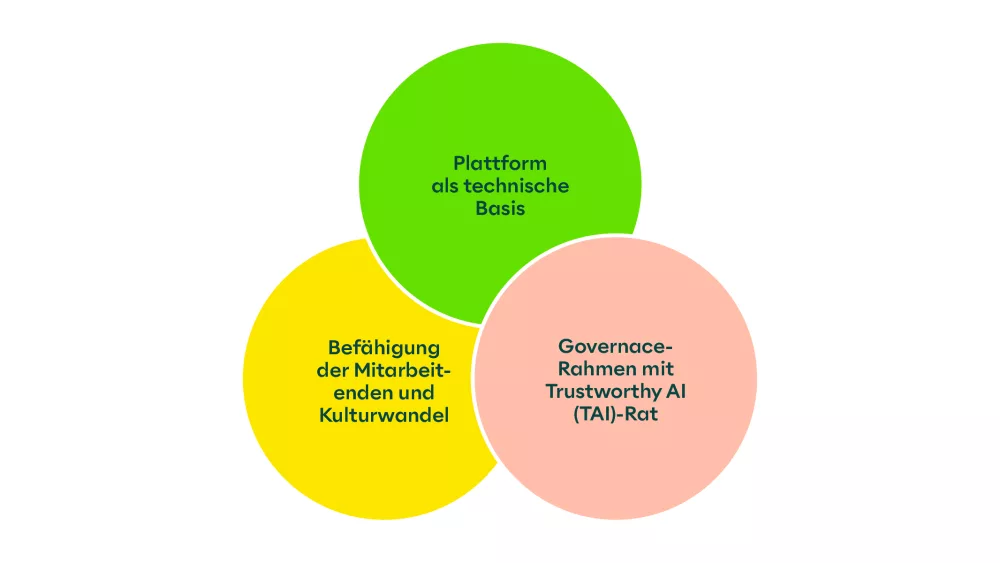

Wie können Unternehmen also von den Vorteilen der individuellen GenAI-Anwendungen profitieren und die Risiken möglichst minimieren? Eine effektive Governance ermöglicht es, diese Technologien verantwortungsvoll und im Einklang mit der Unternehmenskultur einzusetzen. Dabei sollten drei Ansätze im Vordergrund stehen: eine Plattform, die Befähigung der Mitarbeitenden und ein Governance-Framework. Letzteres sollte ein Gremium für den vertrauenswürdigen Einsatz von KI – nennen wir ihn Trustworthy AI (TAI)-Rat – beinhalten und kann die Einführung von Custom GPTs wirksam steuern. TAI ist dabei nicht als Kontrollorgan konzipiert, sondern als begleitende Unterstützung der Mitarbeitenden, um „Trustworthiness by Design“ zu erreichen – also Vertrauenswürdigkeit in KI von Anfang an zu berücksichtigen.

Unserer Erfahrung nach ist die Kombination aus Plattform, Empowerment der Mitarbeitenden und einem Governance-Framework unterstützt durch einen TAI-Rat hervorragend geeignet, um die Balance zwischen Innovation und Kontrolle zu halten.

1. Plattform als technische Basis

Eine zentrale Plattform verhindert Wildwuchs, fördert die Wiederverwendbarkeit von Modellen und ermöglicht eine konsistente Überwachung.

Die Schlüsselaspekte der Plattform sind:

- Werkzeuge für Vertrauenswürdigkeit: Integrierte Funktionen wie Explainable AI (Methoden, die Entscheidungsprozesse von KI-Systemen für Menschen verständlicher und nachvollziehbarer machen), Bias-Erkennung und Datenschutzprüfungen.

- Self-Service-Funktionalität: Mitarbeitende können maßgeschneiderte KI-Tools erstellen, jedoch innerhalb definierter Leitplanken und mit vordefinierten Standards.

- Automatisiertes Monitoring: KI-Modelle werden kontinuierlich überwacht, um Compliance und Leistung sicherzustellen.

TAI-Anbindung: Die Plattform sollte die Standards des TAI-Rates direkt integrieren, so dass die Mitarbeitenden von Anfang an Vertrauenswürdigkeit berücksichtigen.

2. Befähigung der Mitarbeitenden und Kulturwandel

Ohne das Verständnis und die Akzeptanz der Mitarbeitenden wird jede technische oder organisatorische Maßnahme an ihre Grenzen stoßen. Die Schlüsselaspekte sind:

- Wissen vermitteln: Mitarbeitende müssen die Grundlagen von KI, maßgeschneiderte Anwendungen und die Prinzipien von vertrauenswürdiger KI verstehen.

- Zusammenarbeit: Ein transparenter Austausch zwischen Abteilungen ermöglicht den Austausch von Best Practices und den sinnvollen Einsatz von Custom GPTs.

- Unterstützung statt Kontrolle: Der TAI-Rat wird als Förderer und Berater wahrgenommen, nicht als Kontrollinstanz.

TAI-Anbindung: Der TAI-Rat kann als Katalysator fungieren, der die Mitarbeitenden befähigt, KI verantwortungsvoll einzusetzen. Workshops, Leitfäden und aktives Coaching helfen, Vertrauen aufzubauen.

3. Governance-Rahmen mit Trustworthy AI (TAI)-Rat

Ein Governance-Rahmen schafft die notwendigen Standards und Strukturen, ohne die Flexibilität einzuschränken.

Zu den Funktionen des TAI-Rats gehören:

- Beratung: Mitarbeitende erhalten Unterstützung bei Fragen zum Einsatz von Custom GPTs.

- Leitlinien erstellen: Der Rat definiert Regeln und Standards für den Einsatz von KI, z. B. in Bezug auf Ethik, Sicherheit und Datenschutz.

- TAI begleitet den Entwicklungsprozess und sorgt für Transparenz, ohne zu behindern.

- Feedback-Schleifen: TAI sammelt Erkenntnisse aus der Praxis, um die Leitlinien kontinuierlich zu verbessern.

Wichtig dabei: Der TAI-Rat soll die Mitarbeitenden nicht bremsen, sondern sie ermächtigen, vertrauenswürdige und effektive Custom GPTs zu entwickeln.

Zusammenspiel im Dreiklang und schrittweise Umsetzung

Die Plattform bietet die technische Grundlage für einen skalierbaren, sicheren und nutzerfreundlichen Zugang zu Custom GPTs. Empowerment der Mitarbeitenden und stetiger Diskurs bringen einen Kulturwandel, in dem GenAI kreativ und verantwortungsvoll genutzt wird.

Der kulturelle Wandel stellt sicher, dass die Mitarbeitenden befähigt werden, diese Technologien kreativ und verantwortungsvoll zu nutzen. Der TAI-Rat fungiert als Brücke zwischen der technischen und der menschlichen Komponente, indem er unterstützend und vertrauensbildend wirkt.

Für die praktische Umsetzung empfehlen wir ein Vorgehen in vier Schritten:

- Plattform aufsetzen: Aufbau einer einheitlichen Infrastruktur mit klaren Standards und Werkzeugen unter Berücksichtigung der Prinzipien des TAI-Rats.

- TAI-Rat gründen: Definition von Zielen, Zusammensetzung (z. B. Vertreter:innen aus IT, Compliance, Ethik und Fachbereichen) und Arbeitsweise.

- Kultur stärken: Sensibilisierungsprogramme, interaktive Trainings und Pilotprojekte, die den Nutzen des Ansatzes demonstrieren.

- Iterativer Ansatz: Kontinuierliche Weiterentwicklung der Plattform und des Governance-Rahmens auf Basis von Erfahrungen und Feedback.

Ein solcher Ansatz schafft klare Regeln und Standards, die das Vertrauen in KI-Technologien stärken. Eine flexible und unterstützende Governance fördert zudem die Experimentierfreude und Kreativität der Mitarbeitenden. Gleichzeitig werden Risiken in den Bereichen Ethik, Sicherheit und Datenschutz minimiert.

Der Wert einer professionellen Governance zeigt sich insbesondere beim Einsatz von KI-Agenten, die zusätzliche Herausforderungen mit sich bringen. Wenn Agenten autonom agieren oder miteinander interagieren, wie es beispielsweise mit Microsoft Copilot Studio möglich ist, wird die Komplexität in der IT weiter erhöht. Der professionelle Umgang mit Custom GPTs ist ein gutes Trainingsfeld, um sich auf das nächste Komplexitätswachstum in der KI-Nutzung vorzubereiten, den der Einsatz von Agenten mit sich bringen wird.

Haben Sie Fragen oder suchen Sie nach Unterstützung bei der Einführung von Custom GPTs? Unsere Expert:innen stehen Ihnen gerne zur Verfügung.